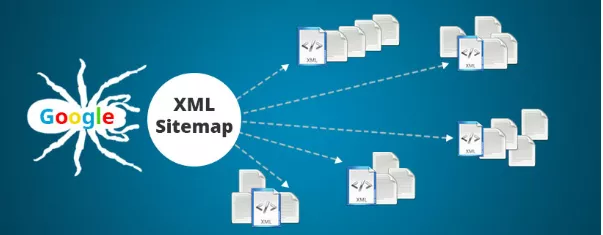

Sitemap.xml на сайта ви може да действа като една добра навигация за страниците, които искате Google ботът да индексира. Тя помага за по-бързото намиране на основните ви страници, дори и ако нямате добро вътрешно налинкване. В тази статия ще представим различни препоръки за оптимизиране на XML Sitemap и защо е добре да го правим.

Функционалности и предимства

Улеснете работата на ботовете и дайте възможност за “съобщаване” за страници и връзки в сайта ви, които може да не бъдат открити лесно.

Можем да отчетем следните SEO предимства, сред които:

- по-бързо индексиране - търсачките ще разберат за новите страници много по-бързо, поради което процесът на индексиране и показването на уеб сайта в резултатите от търсенето ще бъдат по-бързи. Странното, е че също така може да ви помогне и с деиндексирането (повече информация тук);

- по-добро индексиране на вътрешни страници - търсачките могат да открият страниците, които не са открити при обхождането на уеб сайта. Но това не означава, че непременно всички те ще бъдат индексирани.

- мониторинг на индексираните страници. В комбинация с Google Search Console е възможно да разберете кои URL адреси са обхванати в XML Sitemap-а, който Google индексира.

Важен ли е XML Sitemap?

Важен е за сайтове, които:

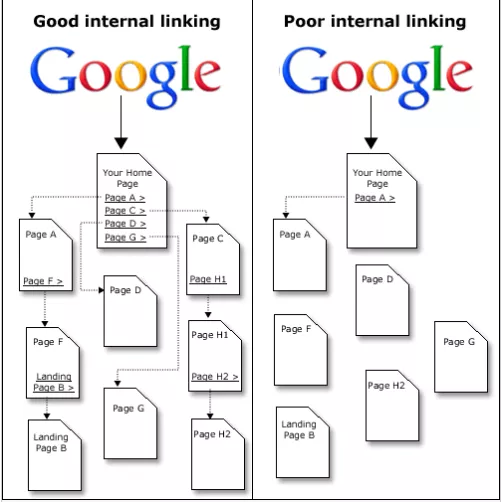

- нямат добра структура или нямат добро разпределение на вътрешните връзки ;

- имат много страници - XMLsitemap помага на търсачките да открият страници, които са нови или актуализира;

- нямат много входящи връзки - това ще е един чудесен начин за откриване на вашите страници.

Изисквания и формати

Google поддържа няколко формата на Sitemap. Всички формати и стандарти можете да откриете на този адрес: https://www.sitemaps.org/index.html .

Всички формати ограничават картата до 50MB (некомпресирана) и 50 000 адреса. Ако имате по-голям файл или повече адреси, ще трябва да създадете индекс файл с всичките карти (описано е по-долу в статията).

Основните препоръки са:

- самият файл трябва да е кодиран с UTF-8;

- започва се с таг за отваряне и трябва да се завърши с таг за затваряне като <urlset>....</urlset>;

- посочете стандарния протокол в <urlset> тага.

- главен таг за всеки запис на URL адрес <url>;

- посочете URL адреса като започнете с протокола (като https или http) в тага <loc>, като той трябва да участва в главния таг за запис.

Съществуват и допълнителни атрибути, които са по избор. Понастоящем трябва да се има предвид, че Google не използват <priority> атрибута в сайтовете си. Всички останали ги вижда, но дали те ще бъдат отразени отново зависи. Затова имайте предвид, че Google не взима особено сериозно под внимание тези тагове. Това са:

- <lastmod> - представлява датата на последната промяна на файла. Трябва да бъде във формат W3C Datetime;

- <changefreq> - колко често е вероятно страницата се актуализира. Тази стойност предоставя обща информация за търсачките. Валидните стойности могат да бъдат always, hourly, daily, weekly, monthly, yearly, never. Трябва да се има предвид, че стойността на този таг се счита по-скоро за намек, а не за команда. Роботите виждат тази информация и я вземат под внимание, но в крайна сметка сами решават дали да я използват, в зависимост от много други фактори.

- <priority> - задава приоритет на URL адреса, спрямо другите URL адреси на сайта ви. Валидните стойности варират от 0.0. до 1.0. Тук отново трябва да се има предвид, че този приоритет е относителен и не е задължително условие за роботите, или поне все още не го приемат като такова. Все пак, ако решите да пробвате използвайте следното ръководство:

- 0.0 - 0.3 : Неактуални новини, информация, която вече не е валидна, но е исторически полезна;

- 0.4 - 0.7: Статии в блогове, категории страници, често задавани въпроси;

- 0.8 - 1.0: Начална страница, продуктови страници, всички страници с добро оптимизирано съдържание.

Следният пример показва Sitemap, който съдържа само един URL адрес и използва всички незадължителни маркери, които са написани в italic.

<?xml version="1.0" encoding="UTF-8"?>

<urlset xmlns="https://www.sitemaps.org/schemas/sitemap/0.9">

<url> <loc>https://netpeak.bg</loc>

<lastmod>2018-09-15</lastmod>

<changefreq>monthly</changefreq>

<priority>0.8</priority> </url></urlset>Определете важните страници

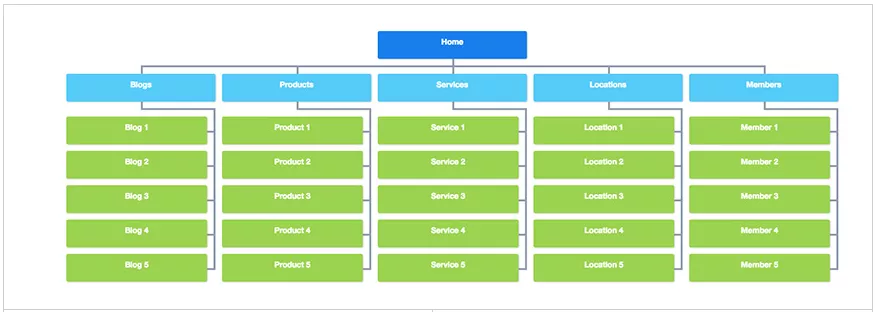

Добавете страниците с високо качество и тези, които са добре оптимизирани. За по-доброто класиране от голямо значение е цялостното качество. Това е един сериозен фактор за Google, който може да ви даде сериозно предимство пред конкуренцията.

Аз не искам да посещавам страници с ниско качество, Google бота също. Ако вие го насочвате към хиляди страници, които не са полезни за потребителите и не са добре оптимизирани, това може да ви изиграе лоша шега. Какви са страниците с високо качество? Най-просто казано това са страници, които:

- имат достатъчно уникално съдържание;

- бързо ангажират потребителите си чрез подтикване към действие (коментари, отзиви и т.н.);

- включват изображения, видеа и т.н.;

- не нарушават правилата на Google;

Отворени за индексация страници

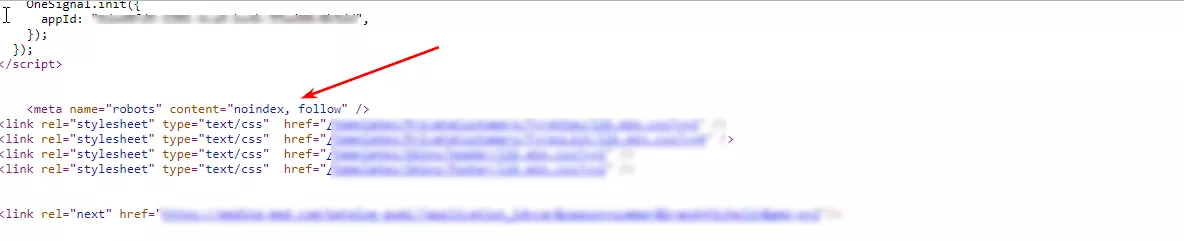

Crawling бюджета представлява най-общо казано това колко страници се обхождат за единица време (ден, седмица, месец и т.н.). Затова не е препоръчително да го пропиляваме ненужно. Не трябва да се добавят страници в картата на сайта, които съдържат мета таг “Noindex”. Важно е да има последователност в действията и всичко да е логически издържано.

Нужно е автоматично да се прави проверка и да не се включват адреси, които са затворени за индексация.

Препоръчително е да се спазват следните инструкции:

- ако страницата https://example.com/category/product има мета таг “noindex”, то не трябва да се включва в XML картата на сайта;

- ако страницата е затворена за индексация през robots.txt, тя отново не трябва да се включва в XML картата:

Disallow: /category/productNoindex: /category/product- ако страницата е затворена за индексация чрез X-Robots-Tag в HTTP header, тя също не трябва да се включва в XML картата на сайта:

HTTP/1.1 200 OKDate: Tue, 25 May 2010 21:42:43 GMT(...)X-Robots-Tag: noindex(...)Канонични версии на страниците

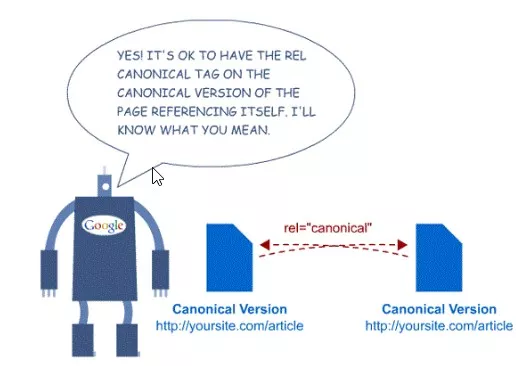

Достъпът до една страница през няколко URL адреса с подобно съдържание ще бъде считан от Google като дублирано съдържание. Трябва да използвате атрибута “link rel canonical”, за да кажете на бота коя страница е “главната” и коя трябва да се обходи и индексира.

Например, ако страницата https://example.com/category/product-1 има canonical към https://example.com/product, то https://example.com/category/product-1 не трябва да участва в XML картата на сайта.

Трябва автоматично да се прави проверка, защото автоматизираният процес ще доведе до по-малко главоболия и ще спести време за ръчни проверки.

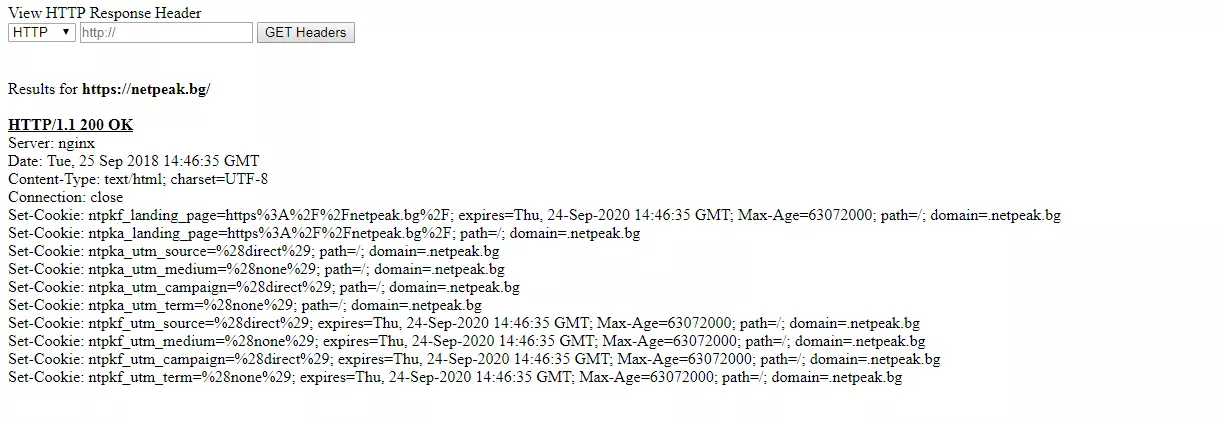

Страници, които връщат 200 OK

Включете адреси, които връщат отговор 200 ОК. Важно е автоматично да се прави проверка и да не се включват адреси, които връщат отговор, различен от 200 ОК - например 404, 301 и т.н.

Например, ако страницата https://example.com/product връща отговор различен от 200 ОК, то тя не трябва да участва в картата на сайта.

Можете да използвате следния инструмент: https://soft.galinov.com/ , за да направите проверка.

Страници от страницирането

Не е нужно да се включват абсолютно всички страници в sitemap.xml. Ботът е достатъчно умен, за да успее да се ориентира и от първата страница в съответната категория, ако е описана, както трябва. Препоръчително е да се включат само:

- Главните страници от категориите;

- Да се маркират страниците с rel=next / rel=prev, така, че роботът да види връзката между тях;

- Всяка страница от страницирането да има и canonical към себе си, а не към главната такава, защото ако е обратното вие казвате на бота “Няма значение, че имам 5000 продукта и 20 страници, те са едни и също като на първата.”.

Например, страницата https://example.com/category/page-2 не трябва да участва в картата. Споделяме ви и официалното становище на Google, както и техни препоръки:

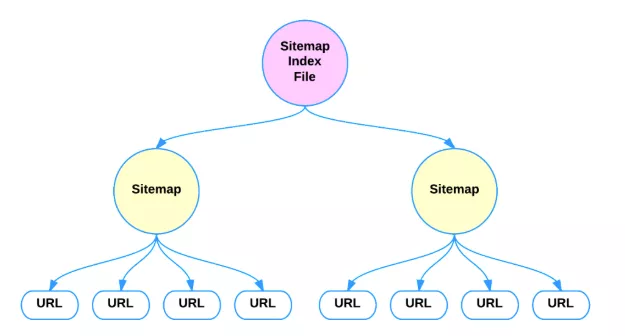

Минимизирайте размера на файла

Google и Bing увеличиха размера на файловете от 10MB до 50MB през 2016г., но все пак е добра практика да запазите своя Sitemap възможно най-малък.

Разбира се, не е нещо, което трябва да ви притеснява, но ако картата на сайта ви съдържа повече от 50 000 URL адреса или размерът й надвишава 50MB, то тя би трябвало да се разбие на повече XML карти. В този случай препратките към всички XML карти се описват в отделен sitemap index file.

Какво представлява Sitemap Index File

Можете да предоставите няколко файла на Sitemap, но всеки файл трябва да отговаря на горепосочените правила. Ако искате можете да компресирате файловете с помощта на gzip, за да намалите изискванията.

XML форматът на индексния файл е много подобен на нормалния формат за карта на сайта. Той трябва да съдържа:

- таг за отваряне и за затваряне като <sitemapindex> </sitemapindex>;

- да включва запис за всеки Sitemap като основния XML атрибут е <sitemap>;

- да се включи таг <loc> към основния атрибут <sitemap>.

Препоръчителният атрибут <lastmod> също е включен.

Забележка: Индексният файл на Sitemap може само да посочва карти, които се намират на същия сайт. Например:

https://example.com/sitemap_index.xml може да включва карти на https://example.com, но не и на https://www.saitprimer.com или на https://www.example.com

Както и при всички останали, индексният файл трябва да е кодиран с UTF-8.

Следният пример показва индекс на Sitemap, който изброява две карти:

<?xml version="1.0" encoding="UTF-8"?>

<sitemapindex xmlns="https://www.sitemaps.org/schemas/sitemap/0.9">

<sitemap> <loc>https://www.example.com/sitemap1.xml.gz</loc>

<lastmod>2018-10-01T18:23:17+00:00</lastmod>

</sitemap> <sitemap>

<loc>https://www.example.com/sitemap2.xml.gz</loc>

<lastmod>2017-01-01</lastmod> </sitemap></sitemapindex>Описване на мобилна версия

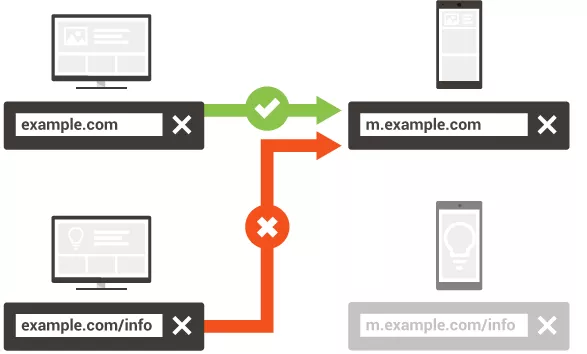

Трябва да помогнем на Google бота да открие съдържанието ни и да разбере връзката между страниците за настолни компютри и мобилни устройства. В XML картата на сайта трябва да се добави атрибут rel=”alternate” за страниците от десктоп версията, по следния начин:

<?xml version="1.0" encoding="UTF-8"?><urlset

xmlns="https://www.sitemaps.org/schemas/sitemap/0.9"xmlns:

xhtml="https://www.w3.org/1999/xhtml"><url><loc>

https://www.example.com/page-1/</loc>

<xhtml:linkrel="alternate"media="only screen

and (max-width: 640px)"href="https://m.example.com/page-1"

/></url></urlset>Трябва да се има предвид, че е необходимо всяка десктоп страница да съответства на една страница от мобилната версия. Не е препоръчително, например, няколко десктоп страници да са свързани чрез rel=”alternate” към една страница от мобилната версия и обратното.

Проверявайте също така и пренасочванията. Защото е важно десктоп страницата да съответства на същото съдържание и в мобилната версия, а не да пренасочва към друга. Допълнителна информация тук.

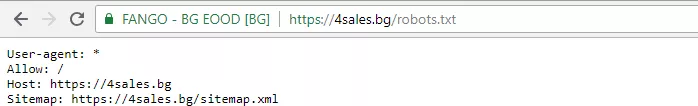

Как ботовете да открият вашия Sitemap

Когато приключите с цялата автоматизация на процеса и го качите на вашия сървър (или генерирате чрез плъгин), трябва да дадете следа къде могат да го открият.

Най-добрият начин е да включите връзка към него във вашия файл robots.txt. Това се нарича още Sitemap Discovery и е нещо, което Google, Bing и Yahoo представиха още през 2007г., за да помогнат на техните роботи да намират XML Sitemap.

Трябва само да включите пълния път към вашата карта или индексен файл.

Правилна транслитерация на адресите

В официалната документация на Googlе (Build and submit a Sitemap) се подчертава, че всички стойности на данни (включително и URL адресите) трябва да съдържат само ASCII символи. Тя не може да съдържа контролни кодове или специални знаци като * или {}. Ако URL адресът на сайта ви съдържа тези знаци, ще получите грешка когато опитате да го добавите.

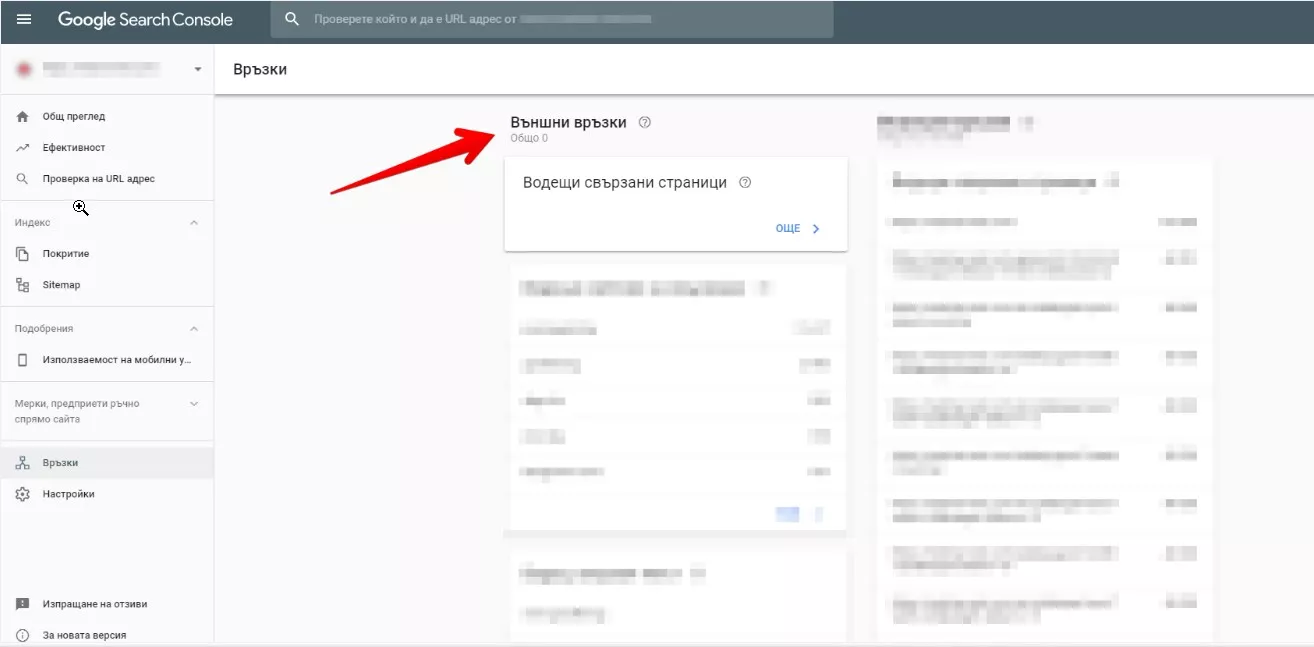

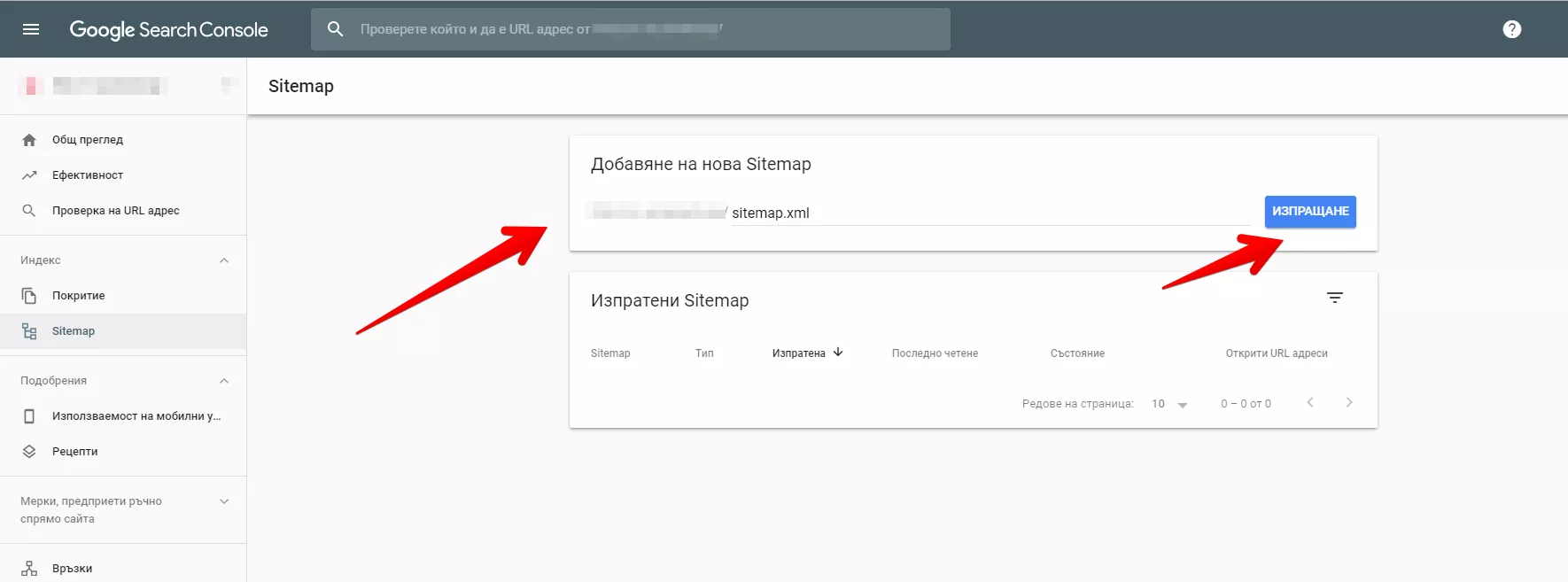

Изпратете вашата карта до Google

Можете да изпратите картата на своя сайт до Google от Google Search Console.

Прегледайте за грешки, преди да я изпратите. Важно е да бъдат изчистени тези грешки, които могат да бъдат пречка за индексирането на ключови целеви страници.

В най-добрия случай броят на индексираните страници трябва да бъде същият като броя на подадените страници.

Заключение

- Бъдете последователни - ако е блокирана страницата от robots.txt или чрез “noindex”, то по-добре да не е във вашата XML карта.

- Автоматизирайте процеса си - всички горепосочени препоръки трябва да могат да се автоматизират, защото по този начин ще си спестите време, ще помогнете на Crawling бюджета да остане оптимизиран, а също така ще си спестите много главоболия.

- Ако имате много голям сайт, използвайте индексен файл с различни карти, които да ви помогнат да спестите сървърно време, а и да обхванете всички важни страници във вашия сайт.