Сайт попал под фильтр. Так ли страшен черт, как его малюют?

1. Когда клиент говорит, что у него фильтр, то что он может иметь ввиду?

Скорее всего, клиент хочет сказать о том, что у него просели позиции по каким-то фразам, за которыми он следил. Возможно, у него даже увеличилось количество посетителей, но сайт по какому-то запросу стал не 2-м, а 3-м. Иногда такие колебания в позициях вызывают панику. В любом туманном случае нужно разбираться более детально. Возможно, дело банально в том, что на сайте «что-то поломалось». Ну а, возможно, клиент действительно видел в Google Webmaster Tools предупреждение о санкциях, так или иначе примененных в отношении сайта.

2. Какие фильтры бывают официально и неофициально?

2.1 Официально

Давайте разберемся, о каких фильтрах Google нам сообщает официально. В Справке написано, что в Google Webmaster Tools могут появляться сообщения, извещающие о том, что в отношении сайта действуют какие-либо меры, принятые вручную. Это:

- искусственные ссылки на ваш сайт (меры в отношении ссылок);

- искусственные ссылки на ваш сайт;

- искусственные ссылки на вашем сайте;

- взломанный сайт;

- неинформативное бесполезное содержание;

- спам;

- спам, созданный пользователями;

- маскировка и/или скрытая переадресация;

- скрытый текст или и/или избыточное количество ключевых слов;

- бесплатный хостинг, распространяющий спам.

Информация об этих мерах показывается в GWT, в разделе «Поисковый трафик» (пункт меню «Меры, принятые вручную»). Многие из этих сообщений очень сложно получить, если вы не занимаетесь чем-то вроде дорвеев или другими ресурсами, созданных исключительно в целях заработка любыми путями.

В свете последних обновлений в работе Google, часто стали встречаться сообщения «Искусственные ссылки на ваш сайт» и «Искусственные ссылки на ваш сайт (меры в отношении ссылок)».

В каких же случаях можно получить эти сообщения?

Искусственные ссылки на ваш сайт (меры в отношении ссылок)

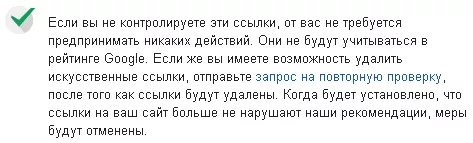

В данном случае меры приняты по отношению к ссылкам, которые ведут на наш сайт. Т.к. Google посчитал многие из этих ссылок спамными и решил, что владельцы сайта занимаются не очень честными способами получения ссылок и пытаются обмануть поисковую систему, чтобы увеличить количество посетителей. В связи с этим Google решил не учитывать часть наших ссылок до тех пор, пока мы не разберемся и не исправим ситуацию. Меры применяются, как видно из картинки, только к части входящих ссылок. Извещение о такой ситуации выглядит так:

Рекомендации от Google при таком типе фильтра:

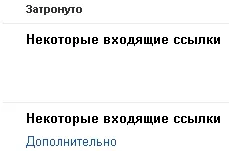

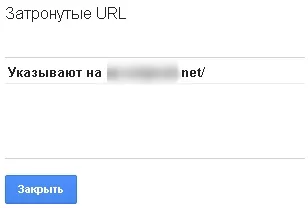

В некоторых случаях Google может указывать, куда ведут некачественные ссылки (такое извещение появляется если ссылки указывают на поддомен):  Нажимая на кнопку «Дополнительно», мы получаем список поддоменов:

Нажимая на кнопку «Дополнительно», мы получаем список поддоменов:

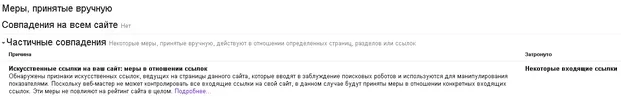

Искусственные ссылки на ваш сайт

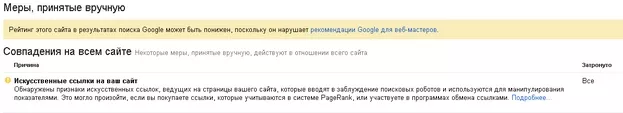

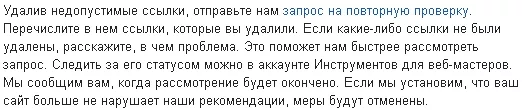

В данной ситуации Google посчитал, что владелец сайта очень-очень сильно нарушил рекомендации для вебмастера в отношении качества ссылок. Тут уже меры применяются ко всему сайту в целом. Весь ссылочный профиль считается спамным. Чтобы избавиться от такого фильтра, придется удалять и отменять через внутренний инструмент GWT очень много входящих ссылок. Выглядит извещение при этом так:

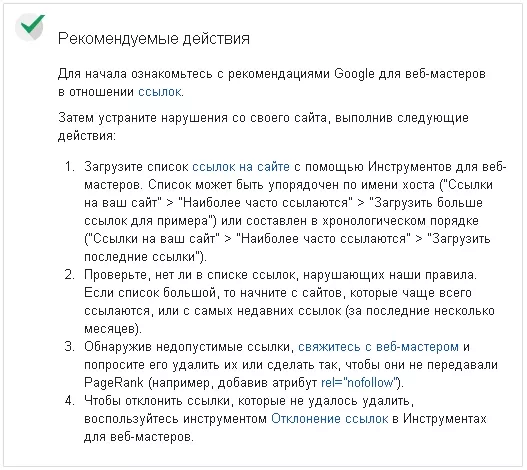

Рекомендации из справки Google при таком типе фильтра:

2.2. Неофициально

Как узнать о неофициальных фильтрах? Если точно нельзя узнать, то как узнать неточно? Само собой, применяемые меры могут быть не только ручными. И далеко не обо всех мерах нас может известить GWT.

Давайте посмотрим, что пишут и говорят в целом о фильтрах

В данном видео Мэтту Каттсу был задан вопрос о том, существуют ли «вечные» фильтры или, при внесении необходимых изменений, ситуация исправится? Мэтт ответил, что, во-первых, все применяемые к сайтам меры бывают ручные и автоматические. Команда по борьбе со спамом получает различные сигналы о нарушениях и создает на основе них классификаторы, которые могут уже в автоматическом режиме распознавать такие нарушения.

О многих автоматических фильтрах ходит масса рассказов, легенд, слухов и т.д. О них очень много написано на разных форумах и блогах. Достаточно погуглить запрос ‘google penalties list’ и можно до утра читать, читать и читать. Само собой, даже при том, что очень много слухов и легенд, существуют фильтры и разного рода пессимизации, о которых представители Google не говорят, но вебмастера-то замечают. В любом случае, при наложении какого-то фильтра или пессимизации ресурса — это заметно.

Например, хорошая и интересная статья по популярной тематике совершенно не приводит посетителей на сайт. Или уменьшился трафик на какую-то категорию. Такие примеры явно говорят о том, что с сайтом возникли какие-то проблемы. В данном случае могут помочь статьи вебмастеров о тех типах фильтров, которые они замечают. Можно сравнить со своим сайтом.

3. Значит ли официальный фильтр, что сайту конец? Что можно делать новый сайт и закрыть старый

Совсем нет. В этом же видео Мэтт говорит о том, что, если в отношении сайта были приняты меры и вы получили фильтр, то после внесения изменений, после переиндексации Google-ом сайта, все вернется на круги своя. Опять же, возвращаясь к нашим реалиям и к тому, что очень многие пострадали от обновления «Пингвин», можно сказать, что есть смысл чистить ссылочную массу, отправлять ссылки на удаление и делать запрос на пересмотр.

4. При выходе из официального фильтра вернутся ли трафик/позиции/жена/увеличится ли зарплата?

Мы смогли снять уже больше 20 фильтров и по большинству проектов восстановление трафика (и позиций по многим маркерным запросам, а также тому самому «длинному хвосту») происходит практически сразу же - через день или два. Бывает, что нужно чуть больше времени — неделя-две. Вот наглядный пример графика посещаемости сайта до/во время/после снятия фильтра. По резким скачкам наглядно видно, когда сайт получил фильтр и когда мы его сняли:

Поэтому ни в коем случае не стоит опускать руки и расстраиваться, а нужно добиться отмены санкций в отношении своего сайта.

В Netpeak мы разработали алгоритм, который позволяет с достаточно высокой вероятностью показать риск для того или иного сайта получить фильтр. Проверка большого списка украинских и российских сайтов показала, что, скорее всего, под фильтром (либо где-то на грани) находится примерно треть списка. По многим сайтам, действительно, в Serpstat (ex. Продвигатор) уже наблюдается падение количества запросов в поиске.

5. Как выходить из-под официального фильтра? Снимать ли все ссылки?

Сотрудники Google говорят о том, что нужно привести сайт в порядок, убрать плохие ссылки (перестать покупать ссылки в биржах или написать вебмастерам просьбу удалить ссылку или закрыть ее в nofollow). После этого можно отправлять запрос на пересмотр и, если сайт более ничего не нарушает, то ситуация исправится. Инструкции о том, как отсеивать разные некачественные ссылки, периодически публикуются. К примеру, 10 признаков естественных ссылок описал Девака. Также у Сергея есть перевод статьи с официального блога Google о самых насущных вопросах про фильтры, которые волнуют вебмастеров. Снимать все ссылки не нужно ни в коем случае, т.к. в этом случае мы отправляем на отклонение и полезные ссылки тоже. Получается, что мы просто начинаем с нуля. В этом случае исчезнут посетители/позиции и т.д. просто из-за того, что мы отключили все ссылки — и хорошие, и плохие.

6. Может ли при официальном фильтре быть рост рост трафика/позиций? Да, само собой. В связи с тем, что меры могут применяться в отношении только некоторых ссылок, то фильтр не будет распространяться на весь сайт целиком. Есть примеры сайтов, у которых в GWT есть сообщение о частичном фильтре (санкции в отношении некоторых ссылок), но при этом график в Google Analytics выглядит как в учебнике — вправо и вверх.

7. Если сайт попал под фильтр, то кто виноват?

Очень логичный вопрос, возникающий сразу же после получения фильтра. С точки зрения клиента виноваты оптимизаторы. Но что-то подсказывает, что виноваты оптимизаторы ровно настолько, насколько виноваты строители, которые построили дом, а землетрясение в 12 баллов разрушило его. Землетрясение в 12 баллов зачастую очень точно описывает то, что происходит в выдаче Google:

Двенадцать баллов — меняется земная поверхность; трещины в земной коре достигают ширины до 10-15м., глубины — до 10м и более, смыкаясь или оставаясь открытыми при следующих толчках; амплитуда вертикальных колебаний почвы достигает полуметра; большие площади оседают и могут быть затоплены, или воздымаются — с амплитудой до нескольких десятков метров и больше; происходят смещения вдоль разломов.

Интересным примером, который мы получили по одному из наших проектов, была ссылка в nofollow! И это при том, что официальная позиция Google заключается в том, что рекламные ссылки нужно закрывать в nofollow, чтобы робот не учитывал эту ссылку при расчете PageRank. Такие ссылки никоим образом не могут попадать в список плохих. Ан нет. Получите и распишитесь.

Про то, что даже естественные ссылки приходят в качестве примеров, мы уже молчим. Есть много разных казусов с плохими ссылками. Про этом мы даже сделаем отдельную публикацию в блоге, где рассмотрим какие ссылки Google присылает. В том числе и естественные, и закрытые nofollow, и т.д. Попробуем разобраться, действительно ли эти ссылки плохие (а в Google-группах представители Google пишут, что такие ссылки были выбраны в качестве примеров ошибочно. В чем мы очень сомневаемся и в следующей статье постараемся объяснить почему) и приведем свое видение того, почему Google присылает все эти ссылки как плохие. По нашей логике можно объяснить, почему даже естественные ссылки считаются плохими.

Просто Google формирует критерии, которым должны соответствовать хорошие ссылки (к примеру, в руководстве для вебмастеров), а через какое-то время можно за такие ссылки получить 100% фильтр. И далеко не факт, что те ссылки, которые работают сегодня, будут работать через год или два. Мало ли в какую сторону изменится политика Google.

Оптимизаторы всегда стараются подстраиваться под условия, актуальные на данный момент. Ведь зачастую многие клиенты хотят быть в топе прямо сейчас (ну или через месяц-два). Какие после этого будут последствия? Вероятнее всего — фильтр. Кто виноват? Конечно же, оптимизаторы! «Понапокупали плохих сылок, а мой сайт под фильтр из-за них попал! Пойду к другим оптимизаторам, они сказали, что используют только белое SEO». В связи с такими изменениями в подходе Google к плохим ссылкам, на поисковую систему начинаются откровенные серьезные нападки.

К примеру, на прошедшей в Лас-Вегасе конференции PubCon бывший директор Mahalo.com Джейсон Калаканис с трибуны заявил, что Мэтт Каттс может улыбаться в глаза, а потом отобрать и смыть в унитаз все ваши пятилетние усилия, которые были потрачены на построение бизнеса.

Джейсон Калаканис

Кроме того, на этой же конференции Джим Бойкин заклинал маркетинговые агентства не говорить о том, что они делают только белое SEO, и одновременно — что могут легко поднять позиции любого проекта по коротким высокочастотным запросам, добыв кучу ссылок с ключевыми фразами в анкорах с форумов, директорий и гостевых постов.

Джим Бойкин

Источник информации о PubCon — ain.ua.

То есть достается очень многим и, как и в любой другой ситуации в жизни, не бывает так, что виноват кто-то один. Ответственны всегда обе стороны.

8. Как быть?

Для начала не нужно принимать поспешных решений. Если вы попали под фильтр и получили в GWT сообщение о мерах в отношении ссылок, то нужно хладнокровно проанализировать состояние сайта и попытаться понять, что именно привело к наложению фильтра. Далее нужно постепенно исправлять обнаруженные ошибки, отклонять плохие ссылки, писать вебмастерам, просить удалять или закрывать в nofollow те ссылки на ваш сайт, которые вам не нравятся, составлять и отправлять запросы на пересмотр.

Конечно, не стоит ожидать, что трафик вернется на тот же самый уровень, что и был до фильтра. Особенно, если отклонили много ссылок и в общую кучу попали хорошие ссылки тоже. Хотя зачастую после съема фильтра трафик возвращается на довольно высокий уровень и продолжается рост. Накопив опыт съема фильтров и отработав методологию, мы запустили новую услугу, которая позволяет ликвидировать меры, принятые в отношении клиентских сайтов. Результат данной услуги — отмена этих мер, о чем свидетельствует надпись в GWT о том, что никаких мер в отношении сайта не принято.

По теме

SEO-аналитика: гайд для начинающих

Узнайте, какие метрики важно отслеживать в SEO-аналитике, для чего они нужны и какую пользу приносят бизнесу

Ответы сервера — подробная инструкция

Правильное распределение кодов ответов сервера позволяет поисковым системам экономить ресурсы на работу с сайтом. Поисковые роботы будут получать только необходимую информацию

Как провести анализ юзабилити сайта онлайн

Аудит юзабилити способствует следованию современным тенденциям, пониманию целевого посетителя и увеличению конверсии.

Свежее

Как настроить рекламу в Facebook Messenger, Instagram Direct и даже WhatsApp

Пошаговая инструкция о запуске рекламы в мессенджерах.

Как написать качественное и эффективное объявление для поисковой кампании в Google Ads

Заставьте пользователя не просто увидеть вашу рекламу, а нажать на неё

Как объединить данные из Meta, TikTok, Google Ads и DV360 в одном отчете: кейс из медийной аналитики

Объединили данные из четырех систем в едином пространстве, автоматизировали отчетность и построили корректный подход к расчету охвата и частоты показов